Re: [閒聊] 日本模型展疑似出現3D掃描作品的小偷

目前的工具精度可能的確不太夠

但這個問題正以肉眼可見的速度被解決

最近有個新技術叫做神經輻射場 Neural Radiance Field 簡稱NeRF[1]

發表在ECCV 2020

可以透過若干張2D圖像生成新視角跟3D建模

主要原理是給定座標和視角

預測空間中各個點的RGB跟密度(可以想成透明度)

最後再沿著新視角把各點的值累加

就是新視角看到的樣子

拿個常見的demo來說

有大約100張不同視角的lego車圖

https://i.imgur.com/UvNuoyp.png

https://i.imgur.com/CP2dSUP.gif

那麼在現實場景的表現如何呢

Google在CVPR 2021發表了NeRF in the wild[2]

搜集各個景點大家拍的照片去訓練

解決一些遮擋 相機參數 光線不一致之類的問題

也做出不錯的成果(以下影片)

https://storage.googleapis.com/nerf-w-public/videos/sacre/flythrough_v3.webm

那為什麼這個工具還沒普及呢

主要原因是要訓練很久

原版的NeRF要訓練好幾個小時甚至好幾天

不過好消息是這個問題在上個月被Nvidia解決了[3]

把訓練時間壓到幾秒鐘

沒錯就是幾秒鐘

連render都可以做到幾10FPS

雖然說隨便拍個照錄個影片幾秒鐘得到3d模型還有待開發

但是可以預見這類型的應用即將走進移動端

在這個各大廠力押ARVR的時代

相信大家可以期待一下

Reference:

[1] Mildenhall, Ben, Pratul P. Srinivasan, Matthew Tancik, Jonathan T. Barron, Ravi Ramamoorthi, and Ren Ng. "Nerf: Representing scenes as neural radiance fields for view synthesis." In European conference on computer vision, pp. 405-421. Springer, Cham, 2020.

[2] Martin-Brualla, Ricardo, Noha Radwan, Mehdi SM Sajjadi, Jonathan T. Barron, Alexey Dosovitskiy, and Daniel Duckworth. "Nerf in the wild: Neural radiance fields for unconstrained photo collections." In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 7210-7219. 2021.

[3] Müller, Thomas, Alex Evans, Christoph Schied, and Alexander Keller. "Instant Neural Graphics Primitives with a Multiresolution Hash Encoding." arXiv preprint arXiv:2201.05989 (2022).

※ 引述《S890127 (丁讀生)》之銘言:

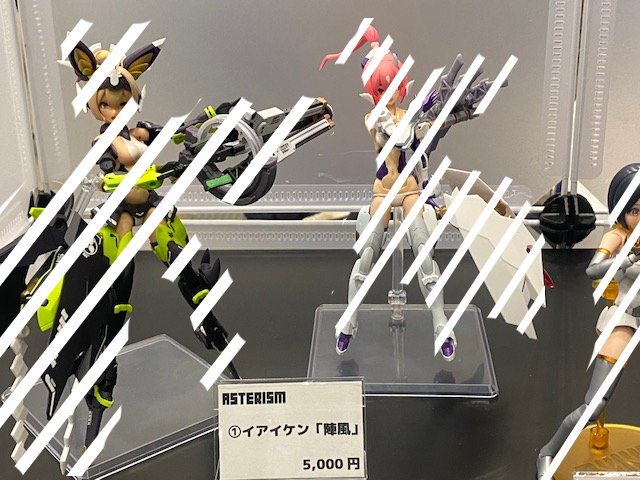

: 日本海洋堂主辦的 ワンフェス(Wonder Festival)

: 有參展人士在推特表示

: https://twitter.com/FLT44000/status/1490582145835798534

: 有拿著顯示奇怪畫面的智慧型手機的三人組(沒有說日文)到我的展區來。

: 現在才懂他們在幹嘛。

: 原來是深度感測(Depth Sensor)

: 原來是在用 LiDAR...

: 推主重現看到的手機畫面

: https://pbs.twimg.com/media/FK_tfoVaMAAYazX.jpg

: 雖然不保證能複製到完全一樣的精細度,但沒付錢、未經許可

: 跑去掃描人家的商品模型,這算是犯罪了吧?

: 也許再過幾年技術變得更精密,真的會有人拿手機去掃描模型來自製了?

--

這差蠻多的吧。

幫補一下 最近的研究可以不用幾分鐘就好了

沒看到有放XDD 抱歉

其實不是很稀奇 幾年前我就看過有拿幾張照片生3d模的技術

身為一位職業機器學習工程師 訓練跟辨識是完全不同的

不過以前不知道多快就是

nvidia壓縮的是辨識時間 不是訓練時間

建議修改內文 不要提供錯誤資訊

是訓練喔 我已經reproduce在自己的dataset上過了

單純好奇辨識在這個task的意思是什麼 0.0

看了論文 你是對的 我道歉

3D建模領域用的字眼跟機器學習不同 是我錯了

這裡居然不用inference 而是用NN的BP提供定位修正

好強

哇噻這篇好強 感謝分享

這我就講了啊這個模型只能看看

生成的模組佈組你給建模師看他會跳起來打人

b大您好 如果您對這方面有了解的話 是否能說明怎樣的精度符合建模師的要求 我們做這方面很歡迎跟其他領域的合作 畢竟了解並實際解決問題才有價值

這個的產物是圖而不是模型,實用性差遠了

Nerf不會給你3D模型,他只是把場景壓縮到model裡面而已

該應用現在優勢是它inference超擬真畫面的能力,用GPU搭

配各種normal, diffusion和specular map跟光追rendering

也需要花不少時間得到擬真畫面。

簡而言之Nerf不會給你模型,你沒辦法做到改顏色,剝掉衣

服,豐胸提臀等3D模型才能搞的事情。

M大您好 我不太清楚一般3D建模是用什麼格式 但是在NeRF原作中已經可以轉成mesh 最近也有一篇衍生作Point-NeRF可以轉成point cloud 透過NeRF建模應該是可行的?

※ 編輯: yiefaung (166.170.32.137 美國), 02/11/2022 08:21:36你如果是說那個黃色voxel工程車的話那個品質完全沒價值

3D模基本組成是vertices, triangles和texture,從multivi

ew image或points cloud轉出來的你解析度要又高又準才能

勉強看起來像是一般的模型

https://youtu.be/t06qu-gXrxA 31:00處你可以看到他的點

數面數相較於品質來說非常可怕

原來如此 感謝解說 不過看到這個還是覺得大有可為哈哈 拭目以待了

※ 編輯: yiefaung (166.170.32.137 美國), 02/11/2022 10:51:5242

[討論] Google AI 降噪演算法 RawNeRFGoogle 發表的 AI 降噪演算法 RawNeRF 是 NeRF (Neural Radiance Fields) 針對低光照環境研發的版本 可以從數十或數百張 有噪點 的多視角 RAW 照片 重建場景並降噪 產生相當清晰的照片![[討論] Google AI 降噪演算法 RawNeRF [討論] Google AI 降噪演算法 RawNeRF](https://img.youtube.com/vi/JtBS4KBcKVc/mqdefault.jpg)

28

[心得] 聖騎士リッカ 聖騎士莉卡 推薦這到底是甚麼3A H-game 喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔喔 太神了八 如果不介意異種姦的話這款100%必玩![[心得] 聖騎士リッカ 聖騎士莉卡 推薦 [心得] 聖騎士リッカ 聖騎士莉卡 推薦](https://i.imgur.com/qDolDnfb.jpg)

20

[閒聊] 如果機戰呈現出Size差是不是會更有震撼力? 我一直覺得很可惜 明明機體大小差距很多 但是畫面沒表現出來 例如丹拜因大概就是![[閒聊] 如果機戰呈現出Size差 [閒聊] 如果機戰呈現出Size差](https://i.imgur.com/pwiIySMb.jpg)

14

[問題] 請問2D-HD是3D建模做出來的嗎?最新發表的DQ3畫面採用2D-HD 其實也有不少遊戲採用這種方式 八岐旅人 也是其中的代表作品之一 但我很好奇的是![[問題] 請問2D-HD是3D建模做出來的嗎? [問題] 請問2D-HD是3D建模做出來的嗎?](https://i.imgur.com/dOOIGaib.jpg)

7

Re: [金光] 群俠來了可以下載了看到大家都說建模很糟糕,讓我有個疑問 現在布袋戲不是已經常常有讓戲偶在綠幕前拍完以後把整個背景用動畫做出來的場景嗎? 請問如果不使用3d建模,而是直接拿戲偶在綠幕前做出各種動作,然後去背景以後直接放 到遊戲中,這樣的做法有可能嗎 只要不在遊戲裡加進旋轉視角的功能,感覺工作量也不會比建模多吧?6

Re: [閒聊] 牛爸退休先潑你冷水。 你把3D列印想得太美好,你要印出來的東西可以直接用,不是沒有啦。 找一台幾百萬的工業級的3D印表機有機會啦,問題是請廠商印一次要多少起跳哦。 保證買個幾十盒同樣的模型還有找。 更別提要建模還是掃描需要花多大的功夫,絕對不是三兩下就能輕鬆搞定。6

Re: [問題] 3D暈是否高FPS可以解決?提供一些能減小3D暈的方法: 1. 遊戲內如果有FOV選項,建議調高到 90 ~ 110 之間,很多遊戲預設視野比較低(視野窄),太高跟太低都有可能帶來暈眩。 2. 改用滑鼠遊玩,體驗上來說,手把體驗肯定是比較好,但手把是推動類比搖桿"等待"視角轉動,這個過程更容易造成暈眩。 補充一下: 記得不要開「垂直同步」,可能會讓有輸入延遲,手動了畫面慢了幾毫秒才動。4

[閒聊] 將插畫製作成模型時會經過3D建模嗎很多模型都是根據一張插畫製作的 不過一張插畫無法呈現所有角度 而且為了視覺效果,繪師「不一定會忠實呈現」角色 例如某個動作在正面很好看 但從側面就會注意到不協調或不自然的地方

55

[蔚藍]動畫9話(大雷)![[蔚藍]動畫9話(大雷) [蔚藍]動畫9話(大雷)](https://i.imgur.com/0jaeyYKb.jpeg)

49

[閒聊] 玩寶可夢機台 學童花光零用錢![[閒聊] 玩寶可夢機台 學童花光零用錢 [閒聊] 玩寶可夢機台 學童花光零用錢](https://i.imgur.com/AlfIeneb.jpeg)

30

[問題] 九日打完勾芒後去哪27

Re: [蔚藍] 第九話nico評分69

[蔚藍] 第九話nico評分![[蔚藍] 第九話nico評分 [蔚藍] 第九話nico評分](https://i.imgur.com/oNSLhoIb.jpeg)

23

[閒聊] 鳴潮男角太多了吧![[閒聊] 鳴潮男角太多了吧 [閒聊] 鳴潮男角太多了吧](https://i.ytimg.com/vi/161Xvbh0GBo/oardefault.jpg?sqp=-oaymwEkCJUDENAFSFqQAgHyq4qpAxMIARUAAAAAJQAAyEI9AICiQ3gB&rs=AOn4CLCzQWlTHt9YOmdO2GoRKSeT0wsldw)

23

[24春] 極速星舞 08 Nico好評率 79.6%![[24春] 極速星舞 08 Nico好評率 79.6% [24春] 極速星舞 08 Nico好評率 79.6%](https://i.imgur.com/J1Iopcsb.jpeg)

21

[24春] 夜晚的水母不會游泳 1~9![[24春] 夜晚的水母不會游泳 1~9 [24春] 夜晚的水母不會游泳 1~9](https://i.imgur.com/H27A0BSb.png)

20

[Vtub] 6/2同接鬥蟲![[Vtub] 6/2同接鬥蟲 [Vtub] 6/2同接鬥蟲](https://files.catbox.moe/hiycnk.jpg)

19

[24春] 水母08 Nico好評率 78.8%![[24春] 水母08 Nico好評率 78.8% [24春] 水母08 Nico好評率 78.8%](https://pbs.twimg.com/media/GPAamSFbAAAmjSD.jpg)

19

[奶子] 無職的女僕莉莉雅 484整部最瑟情的?![[奶子] 無職的女僕莉莉雅 484整部最瑟情的? [奶子] 無職的女僕莉莉雅 484整部最瑟情的?](https://i.postimg.cc/tgDZCRJf/gifit-1717352928895.gif)

24

Re: [鳴潮] 日版將軍專武說明誤植惹議![Re: [鳴潮] 日版將軍專武說明誤植惹議 Re: [鳴潮] 日版將軍專武說明誤植惹議](https://i.imgur.com/cejF5jMb.jpeg)

18

[GKMS] 麻央真的好可愛![[GKMS] 麻央真的好可愛 [GKMS] 麻央真的好可愛](https://i.imgur.com/OZoPJNvb.jpeg)

61

[閒聊] 這鳳傲天作品的開場讓人吐嘈吐不完啊![[閒聊] 這鳳傲天作品的開場讓人吐嘈吐不完啊 [閒聊] 這鳳傲天作品的開場讓人吐嘈吐不完啊](https://i.imgur.com/OZn5zTib.png)

17

[百合] 水星魔女:我打少女歌劇...真的假的?!![[百合] 水星魔女:我打少女歌劇...真的假的?! [百合] 水星魔女:我打少女歌劇...真的假的?!](https://i.imgur.com/NwziLyFb.png)

15

[蔚藍]老師家變成C&C的聚集地了![[蔚藍]老師家變成C&C的聚集地了 [蔚藍]老師家變成C&C的聚集地了](https://i.imgur.com/MXk6Uhib.jpeg)

70

[閒聊] 杭州動漫展有人COS科比空難現場![[閒聊] 杭州動漫展有人COS科比空難現場 [閒聊] 杭州動漫展有人COS科比空難現場](https://i.imgur.com/Db6YaIEb.jpeg)

16

Re: [閒聊] 月曜日のたわわ![Re: [閒聊] 月曜日のたわわ Re: [閒聊] 月曜日のたわわ](https://pbs.twimg.com/media/GPGnfQAboAAnlBX.png)

15

Re: [鳴潮] 日版將軍專武說明誤植惹議14

[閒聊] 劍星裸裝早期設計![[閒聊] 劍星裸裝早期設計 [閒聊] 劍星裸裝早期設計](https://i.meee.com.tw/SqErxDd.jpeg)

29

[閒聊] 格鬥遊戲故意讓別人很沒品耶13

[閒聊] 原神這次活動高難真的難得很扯12

[閒聊] 鬼滅這集算幫九柱排名了嗎?24

[鳴潮] 聽說內測劇情架構其實比較好?22

[推薦] 九日12

[閒聊] 妙廟美少女 96 三!倍!奉!還!![[閒聊] 妙廟美少女 96 三!倍!奉!還! [閒聊] 妙廟美少女 96 三!倍!奉!還!](https://i.imgur.com/8NVdtlRb.png)

8

[閒聊] mappa超越得了幽浮桌嗎?11

[情報] 「奧術」新海報圖![[情報] 「奧術」新海報圖 [情報] 「奧術」新海報圖](https://i.imgur.com/ZDJlSBab.jpeg)

11

[24春] 上低音號 第三季 09 關西大會名單變動![[24春] 上低音號 第三季 09 關西大會名單變動 [24春] 上低音號 第三季 09 關西大會名單變動](https://i.imgur.com/IIIMg0Kb.jpg)

11

Re: [24春] 吹響吧上低音號三期 09 好痛...